什么是GTX1060 CUDA加速?

基于NVIDIA CUDA并行运算权威框架,透过GPU驱动计算以提升带有效率及速度的 GTX1060 显卡表现卓越。GTX1060采用NVIDIA Pascal精妙构架,搭配出色的CUDA并行运算功能,为科研计算、深度学习以及人工智能应用提供强大支持。CUDA(Compute Unified Device Architecture)即NVIDIA主导的统一设备运算架构,专为开发者设计,方便他们运用C/C++语言撰写用于GPU加速计算的程序,以此充分挖掘GP U潜在的并行计算实力。

伴随科技的飞速发展与大数据时代的到来,大规模数据处理及复杂运算需求日益增长,现有的CPU已不能满足需求,GPU凭借其众多核心和并行计算能力在高性能计算中的优势愈发突显。其中,中高端显卡Geforce GTX 1060借助CUDA加速技术,能够极大地提升计算效能,展现了其在多个领域内无可比拟的巨大潜力

GTX1060 CUDA加速在哪些领域有应用?

科研应用:科研领域如气象学、物理、生物等对大数据处理和模拟运算有高要求的学科,CUDA能明显提升执行速度。借助GTX1060的CNUD加持,科学家得以高效完成模拟实验、分析和图像处理工作,加速科研进程。

深度学习:作为 AI 领域的关键组成部分,深度学习需庞大运算能力支持大规模神经网络训练及分析。运用 GTX1060 的 CUDA 加速功能,可助力提升深度学习模型的训练速率与精度效益。

金融建模:金融行业中,诸如风险管理、投资组合优化以及股票交易等环节,均需借助精密的数值测算与模拟分析。而使用英伟达(NVIDIA)的GTX1060 CUDA技术可显著提升金融模型运算效率及系统稳定性,从而助力金融界专业人士做出更为精准的决策判断。

医影技术在诊治中的运用至关重要。借助CUDA能迅速完成医影图的深度处理、精确三维解读、病源检测等操作,旨在协助医生做出精准判断。

GTX1060 CUDA加速如何实现?

欲实现GTX1060的CUDA技术加速,需先下载并安装NVIDIA官方驱动以及对应的CUDA Toolkit软件包。CUDA Toolkit含有并行计算环境所需的开发模块、库文件及实例代码。设计者可利用该工具箱中的CUDA C/C++语言编写应用程序,再借助特定API以实现GPU的高效运算。

在编写CUDA代码中,需对GPU架构有深入理解,掌握线程块(block)、线程(thread)和内存管理等相关知识。精准定位并行运算需求,充分发挥GPU众多内核优势进行并发计算,以获得较佳性能改善。

除了应用CUDA技术编写出色的程序以外,我们也能利用TensorFlow和PyTorch等尖端深度学习框架,与强大的GTX 1060显卡相配合,提速深度学习操作。另外,专门为 CUDA 进行精细优化的科研计算库,例如cuBLAS,cuDNN等,也能有效简化我们的开发流程,从而实现更高效的编程实践。

如何评估GTX1060 CUDA加速效果?

衡量GTX1060 CUDA性能的考量则包括如下几点:

运行时比对:评估同样程序在CPU与GPU环境的执行耗时,以确保结果精确性且耗时较短。

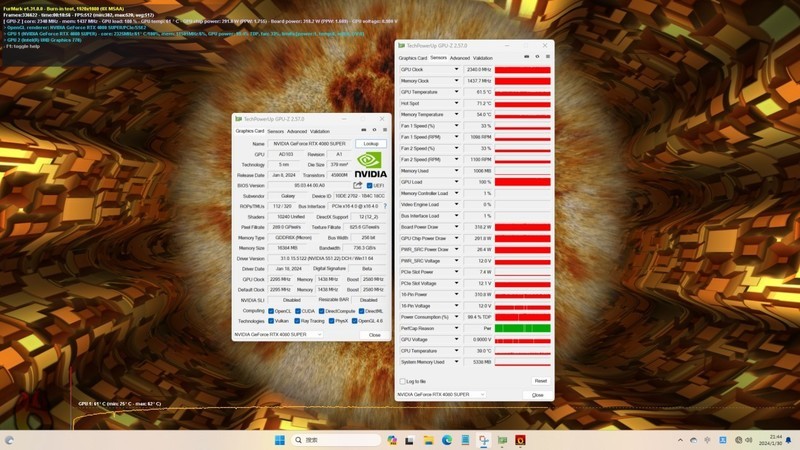

性能指标深入分析:通过实时监测GPU使用率、内存负担及能耗状况等多项关键指标审视CUDA的加速效益,同时灵活调整相关参数以达至最佳运作品质。

适应情境准则:鉴于特定使用条件下的性能需求变化,CUDA程序规划与改善策略必须依据实际应用需求做出相应调整。

精益求精:伴随硬件科技与软件研发的不间断革新与完善,对效果评估过后仍需持续优化,追求卓越性能。

结合实际案例看GTX1060 CUDA加速效果

例如,在图像处理领域内,利用NVIDIA的GTX 1060显卡的CUDA功能,可显著提高诸如图像滤波和边缘检测等常规任务的处理效率。通过巧妙地设计多线程滤波算法,并将其迁移至GPU处理,我们不仅能确保图像质量不受影响,还能大幅度缩短处理时间,特别是在处理大型或批量图片时,可以极大地节省宝贵的时间资源。

此外,深度学习任务中的神经网络训练通常颇具繁琐性及消耗大量资源的特点。有了GTX1060 CUDA的助力,不仅能够有效缩短训练周期,同时更能支持更为复杂且庞大的神经网络架构设计。以图像分类为例,若采用ResNet或Inception这类层次丰富的网络构建,那么利用GPU的加速技术将明显提升训练效能以及模型收敛速率。

未来展望与思考

伴随着科技的飞速发展,GPU并行处理及CUDA技术将拥有更加广阔的应用前景。在未来,随着硬件设备效率的提高和软件开发商的持续创新优化,诸如人工智能、科研、医疗保健等各个领域,我们都有望见证更多基于TGP1060 CUDA加速技术的创新性成果。